DeepSeek udowodnił, że szkolenie AI nie wymaga najdroższych procesorów graficznych, takich jak H100. Zamiast tego firmy mogą osiągnąć wysoką wydajność przy niższych kosztach, korzystając z odnowionych procesorów graficznych NVIDIA A100, V100 lub H800.

Opłacalna sztuczna inteligencja z procesorami graficznymi NVIDIA A100 i V100

Sztuczna inteligencja rozwija się w szybkim tempie, a firmy na całym świecie szukają sposobów na budowę infrastruktury AI bez nadmiernych wydatków. Sukces DeepSeek, chińskiej firmy zajmującej się AI, pokazuje, że zaawansowana sztuczna inteligencja nie wymaga najnowszych ani najdroższych procesorów graficznych – kluczowe jest dobranie odpowiedniego sprzętu do konkretnego zadania.

Na przykład ChatGPT został przeszkolony na procesorach graficznych NVIDIA V100 i A100, podczas gdy DeepSeek wykorzystał około 2000 procesorów graficznych NVIDIA H800 – modelu przeznaczonego na rynek chiński z ograniczoną przepustowością połączeń między chipami w porównaniu do jego globalnego odpowiednika, H100.

Chociaż A100 i V100 to modele poprzedniej generacji, nadal świetnie nadają się do szkolenia i wnioskowania AI. To podkreśla kluczową zmianę – firmy mogą osiągnąć wysoką wydajność AI, korzystając z opłacalnych opcji, takich jak A100 i V100, zamiast inwestować w najnowsze i najdroższe procesory graficzne.

Czym jest DeepSeek?

DeepSeek to chińska firma zajmująca się sztuczną inteligencją, która zyskała światowe zainteresowanie dzięki opracowaniu modelu AI mogącego konkurować z ChatGPT od OpenAI – ale przy znacznie niższych kosztach. W przeciwieństwie do amerykańskich gigantów AI, którzy inwestują miliardy w infrastrukturę, DeepSeek twierdzi, że przeszkolił swój model AI, używając jedynie 2000 procesorów graficznych NVIDIA H800, co dowodzi, że wydajna sztuczna inteligencja nie wymaga najdroższego sprzętu.

To podejście pozycjonuje DeepSeek jako bardziej opłacalną alternatywę w rozwoju AI, kwestionując powszechne przekonanie, że zaawansowana sztuczna inteligencja wymaga ogromnych nakładów finansowych.

Kto jest właścicielem DeepSeek?

DeepSeek został założony w lipcu 2023 roku przez Lianga Wenfenga, absolwenta Uniwersytetu Zhejiang, specjalizującego się w strategiach inwestycyjnych opartych na AI. Jego fundusz hedgingowy, High-Flyer, zapewnił wsparcie finansowe, a sam Wenfeng posiada 84% udziałów w firmie poprzez dwie spółki holdingowe.

Pojawienie się DeepSeek oznacza zmianę w rozwoju AI, pokazując, że modele sztucznej inteligencji mogą być szkolone efektywnie bez miliardowych inwestycji w infrastrukturę, co potencjalnie zmienia sposób, w jaki firmy inwestują w AI.

Budowa serwerów AI przy niższych kosztach z odnowionymi procesorami graficznymi NVIDIA A100

Wraz z rosnącym wdrażaniem AI firmy zmieniają swoje strategie dotyczące sprzętu. Zamiast wydawać miliony na najnowsze procesory graficzne, wiele organizacji wybiera odnowione procesory NVIDIA A100, aby skalować infrastrukturę AI za ułamek kosztów.

Poza Chinami A100 jest najlepszą alternatywą dla H800, oferując podobną moc szkolenia AI z lepszą dostępnością na rynku globalnym. Podczas gdy V100 nadal jest solidnym wyborem do wnioskowania, A100 zapewnia lepszą efektywność, skalowalność i przepustowość pamięci dla nowoczesnych aplikacji AI.

H100 to najpotężniejsza opcja, ale A100 oferuje najlepszy stosunek ceny do wydajności dla firm optymalizujących inwestycje w AI.

Dlaczego warto wybrać odnowione procesory graficzne A100?

✔ Oszczędność do 70% – wydajność AI klasy korporacyjnej przy niższych kosztach

✔ Zrównoważony i wydajny wybór – dłuższa żywotność GPU i mniejsze wydatki IT

✔ Optymalizacja pod kątem AI – idealny do głębokiego uczenia i dużych modeli językowych

Niższe koszty, maksymalna wydajność

Wysokie koszty nowego sprzętu ograniczają adopcję AI, ale odnowione procesory graficzne A100 zapewniają ogromną moc obliczeniową do głębokiego uczenia, szkolenia modeli i zastosowań AI w czasie rzeczywistym – pomagając firmom utrzymać konkurencyjność.

Poza oszczędnościami kosztów odnowione procesory graficzne uwalniają kapitał na badania nad AI, optymalizację danych i rozwój oprogramowania – przyspieszając innowacje przy jednoczesnym zachowaniu elastyczności finansowej.

NVIDIA H100 to zdecydowanie najpotężniejszy procesor graficzny do zadań AI, ale wiąże się z znacznie wyższym kosztem. Z kolei A100 oferuje najlepszy stosunek ceny do wydajności, co czyni go idealnym wyborem dla firm potrzebujących szybkiego szkolenia AI bez konieczności kosztownej aktualizacji do H100.

Jak NVIDIA A100 wypada w porównaniu do H800?

H800 to wariant karty H100 przeznaczony wyłącznie na rynek chiński, zaprojektowany z ograniczoną przepustowością NVLink i niższą ogólną wydajnością z powodu amerykańskich restrykcji eksportowych. Chociaż H800 oferuje solidne możliwości AI, firmy spoza Chin nie mają do niego dostępu i potrzebują alternatywy.

Dla firm spoza Chin A100 jest najlepszą alternatywą dla H800, oferując wysoką wydajność AI i efektywność. Jednak H100 pozostaje najlepszym wyborem dla tych, którzy potrzebują najwyższego poziomu mocy obliczeniowej AI.

| Specyfikacja | NVIDIA H100 | NVIDIA H800 | NVIDIA A100 |

|---|---|---|---|

| Architektura | Hopper | Hopper | Ampere |

| Technologia procesu | 4nm TSMC | 4nm TSMC | 7nm TSMC |

| Pamięć GPU | 80GB HBM3 | 80GB HBM3 | 40GB/80GB HBM2e |

| Przepustowość pamięci | Do 3.35 TB/s (SXM) | ~1.9 TB/s (SXM) | Do 2.0 TB/s (80GB version) |

| Przepustowość NVLink | 900 GB/s | 400 GB/s | 600 GB/s |

| Generacja PCIe | PCIe 5.0 | PCIe 4.0 | PCIe 4.0 |

| Wydajność | Najwyższa wydajność w treningu i wnioskowaniu AI | Obniżona wydajność z powodu ograniczonego NVLink | Wysoka wydajność w treningu AI i HPC |

| Dostępność na rynku | Globalna (AI dla przedsiębiorstw, HPC) | Ograniczona do Chin | Globalna |

| Najlepsze zastosowanie | Duże modele AI, trening LLM, wysokowydajne AI | Kosztowo efektywne AI dla firm w Chinach | Trening AI, deep learning, obciążenia HPC |

Zaoszczędź do 70%, kupując odnowioną kartę graficzną NVIDIA A100 od Renewtech

Karta graficzna NVIDIA A100 Tensor Core została zaprojektowana do szkolenia AI, głębokiego uczenia i wnioskowania. Zapewnia wysoką przepustowość dla wymagających obciążeń AI przy ułamku kosztów nowszych modeli.

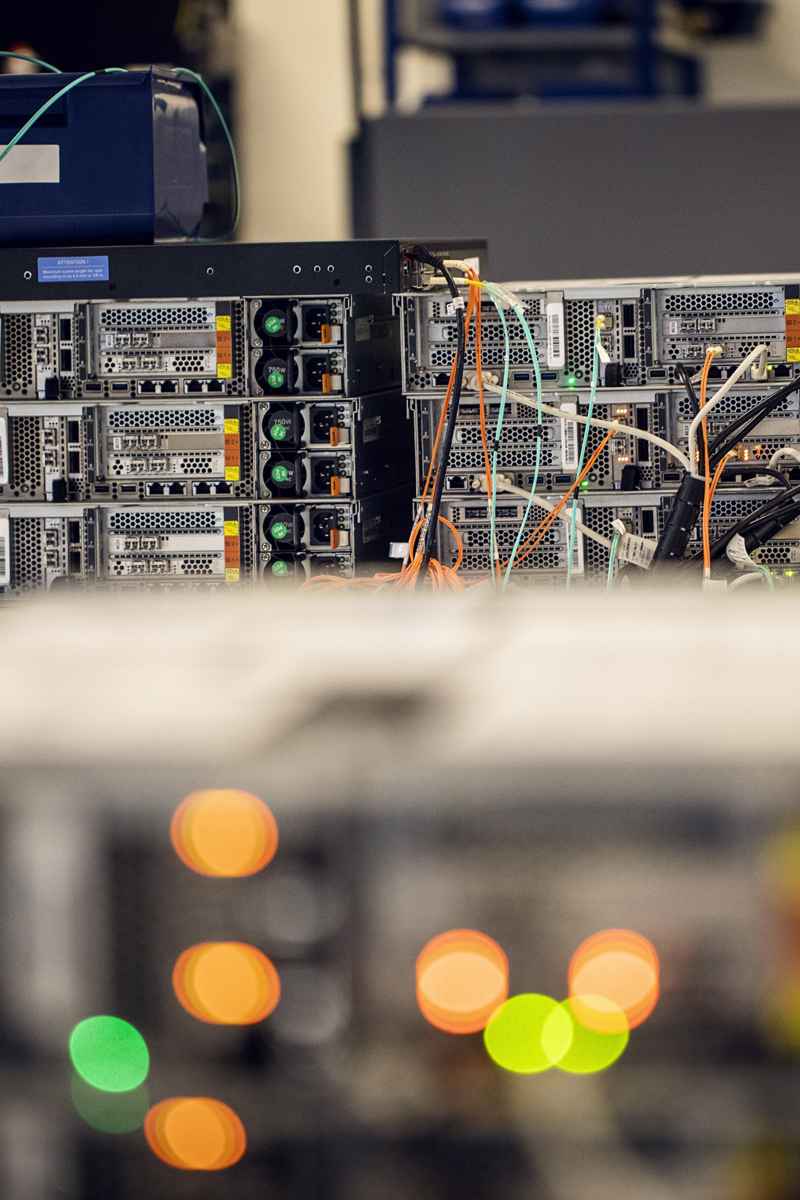

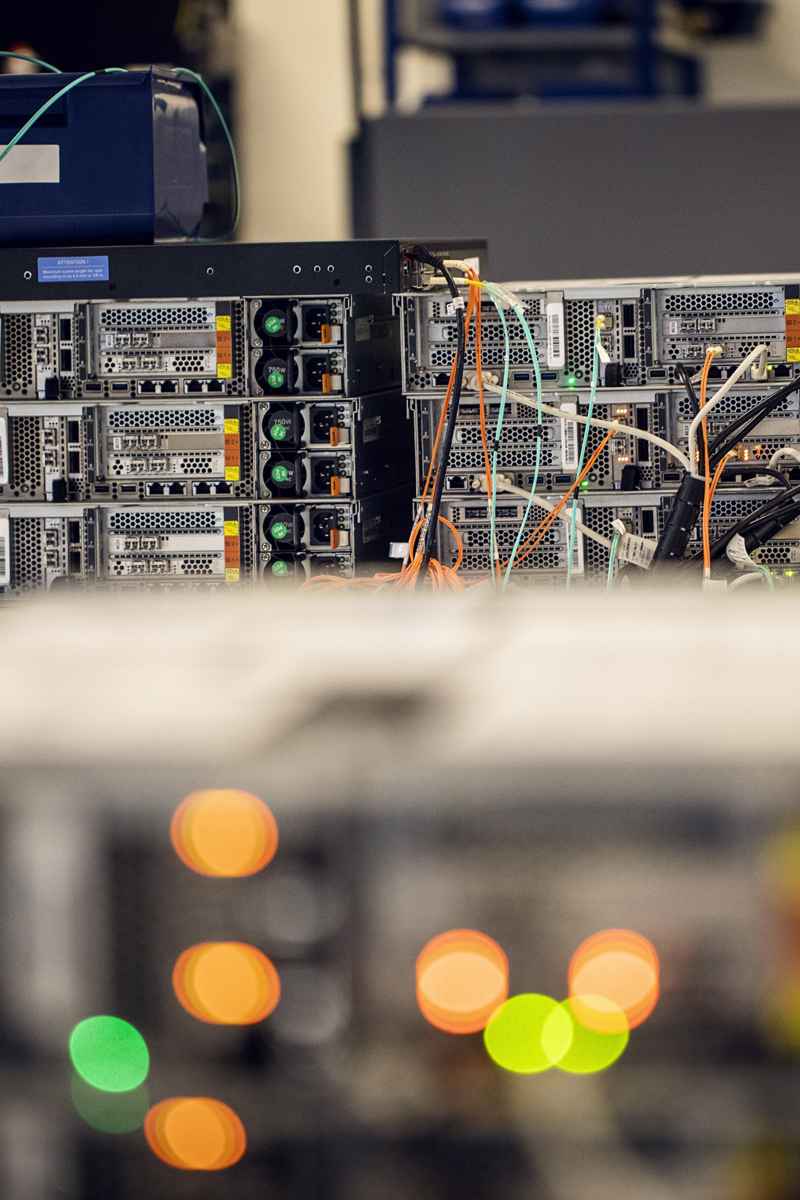

Serwery AI obsługujące NVIDIA A100

Wybór odpowiedniego serwera AI jest kluczowy dla skalowalności, wydajności i opłacalności. Obciążenia AI – takie jak głębokie uczenie, duże modele językowe (LLM) i wnioskowanie w czasie rzeczywistym – wymagają wydajnego sprzętu, aby maksymalizować osiągi bez niepotrzebnych kosztów.

Dla firm, które chcą skalować AI w przystępnej cenie, odnowione karty graficzne NVIDIA A100 oferują wysoką moc obliczeniową przy znacznie niższych kosztach. Aby ułatwić wybór, wybraliśmy dwa wysokowydajne serwery AI, które w pełni obsługują karty NVIDIA A100 – zapewniając idealne połączenie szybkości, niezawodności i opłacalności.

Dlaczego wybór odpowiedniego serwera AI ma znaczenie:

- Optymalizacja obciążeń – Szkolenie AI, wnioskowanie i głębokie uczenie wymagają wydajnych procesorów graficznych, dużej pamięci i szerokiej przepustowości PCIe dla płynnego działania.

- Skalowalność i przyszłościowa inwestycja – Odpowiedni serwer umożliwia płynne rozszerzanie infrastruktury AI w miarę wzrostu zapotrzebowania.

- Efektywność kosztowa – Inwestowanie w odpowiedni sprzęt maksymalizuje zwrot z inwestycji i minimalizuje niepotrzebne wydatki.

Dzięki serwerom AI wyposażonym w karty NVIDIA A100 firmy mogą budować infrastrukturę AI, która zapewnia wysoką wydajność, jednocześnie pozostając w ramach budżetu.

Supermicro SYS-4028GR-TRT vs. Dell PowerEdge R740 dla AI

Wybór odpowiedniego serwera AI ma kluczowe znaczenie dla maksymalizacji wydajności i efektywności. Zarówno Supermicro SYS-4028GR-TRT, jak i Dell PowerEdge R740 obsługują karty graficzne NVIDIA A100, jednak są przeznaczone do różnych rodzajów obciążeń AI.

- Supermicro SYS-4028GR-TRT został zaprojektowany do głębokiego uczenia na dużą skalę, obsługując do 4 kart graficznych NVIDIA A100, co czyni go lepszym wyborem dla firm wymagających dużej gęstości GPU.

- Z kolei Dell PowerEdge R740 obsługuje do 2 kart A100, co czyni go bardziej ekonomicznym rozwiązaniem dla firm koncentrujących się na wnioskowaniu AI i szkoleniu na mniejszą skalę.

Poniżej znajduje się porównanie, które pomoże wybrać serwer AI najlepiej dopasowany do Twojej infrastruktury GPU.

| Funkcja | Supermicro SYS-4028GR-TRT | Dell PowerEdge R740 |

| Obsługa GPU | Do 4x NVIDIA A100 PCIe – Optymalizowane dla obciążeń AI z wieloma GPU. | Do 2x NVIDIA A100 PCIe – Zaprojektowane do przyspieszenia AI z efektywnością kosztową. |

| Opcje CPU | ntel Xeon Scalable (2. gen.) – Obsługa dwóch gniazd dla wysokowydajnego AI. | Intel Xeon Scalable (2. gen.) – Zrównoważone pod kątem obciążeń wnioskowania. |

| Pojemność pamięci | Do 6TB DDR4 – Zaprojektowane do dużych modeli AI i deep learningu. | Do 3TB DDR4 – Obsługuje obciążenia AI, ale z mniejszą skalowalnością. |

| Możliwości przechowywania | Obsługuje do 24x dysków 2.5” (HDD/SSD) – Zaprojektowane dla intensywnego przetwarzania danych w AI. | Obsługuje do 16x dysków 2.5” (HDD/SSD) – Wystarczające dla aplikacji wnioskowania AI. |

| Sieć i łączność | Wiele opcji 10GbE i 25GbE, PCIe 4.0 dla przepływu danych AI o dużej przepustowości. | Podwójne porty 10GbE, PCIe 4.0, odpowiednie dla efektywności wnioskowania AI. |

| Rozbudowa i skalowalność | Więcej gniazd PCIe Gen 4 – Idealne dla konfiguracji z wieloma GPU i przyszłej rozbudowy. | Mocne wsparcie PCIe 4.0 – Dobre dla obciążeń AI, ale ograniczona skalowalność dla wielu GPU. |

| Chłodzenie i zasilanie | Optymalizowane dla wysokiej gęstości GPU – Zaawansowane chłodzenie do obsługi wielu A100. | Wydajne zarządzanie termiczne – Energooszczędne chłodzenie dla obciążeń wnioskowania. |

| Format obudowy i gęstość | Serwer szafowy 4U – Większa gęstość, zaprojektowany do treningu modeli AI na dużą skalę. | Serwer szafowy 2U – Oszczędność miejsca z umiarkowanymi możliwościami przyspieszenia AI. |

| Zastosowanie | Trening modeli AI, deep learning, i LLM – Idealne do badań AI i produkcji. | Wnioskowanie AI, ekonomiczne wdrożenia AI – Optymalizowane dla firm rozwijających AI w sposób kosztowo efektywny. |

Supermicro SYS-4028GR-TRT

Serwer AI o wysokiej gęstości, zaprojektowany do obliczeń wielogpuowych, Supermicro SYS-4028GR-TRT maksymalizuje wydajność NVIDIA A100. Dzięki dużej liczbie linii PCIe 4.0, wysokiej efektywności energetycznej i zaawansowanemu chłodzeniu zapewnia stabilne szkolenie AI oraz wnioskowanie.

- Optymalizacja dla AI i uczenia maszynowego – Obsługuje konfiguracje wielogpuowe, co czyni go idealnym wyborem do głębokiego uczenia i dużych modeli AI.

- Wydajność klasy enterprise – Wysoka przepustowość i efektywne chłodzenie umożliwiają obsługę intensywnych obliczeń AI.

Zwiększ wydajność AI dzięki Supermicro SYS-4028GR-TRT

Dell PowerEdge R740

Uniwersalny serwer klasy enterprise, Dell PowerEdge R740, oferuje skalowalne rozwiązanie dla AI i obciążeń HPC. Obsługując wiele kart NVIDIA A100, zapewnia wysoką pojemność pamięci, wydajne chłodzenie i mocną obsługę PCIe 4.0.

- Skalowalna infrastruktura AI – Konfigurowalny do szkolenia modeli AI, wnioskowania i obliczeń o wysokiej wydajności.

- Opłacalna wydajność – Odnowiony R740 umożliwia firmom integrację AI bez nadmiernych wydatków, zapewniając wysoką wydajność przy niższych kosztach.

Zwiększ wydajność AI dzięki PowerEdge R740

Maksymalizacja wydajności AI z serwerami H100

Dla firm wymagających większej mocy obliczeniowej do zaawansowanych aplikacji AI, modernizacja do kart NVIDIA H100 oferuje jedną z najwyższych dostępnych wydajności AI. Niezależnie od tego, czy pracujesz nad dużymi modelami głębokiego uczenia, szkoleniem LLM, czy wnioskowaniem AI w czasie rzeczywistym, odpowiednia infrastruktura serwerowa ma kluczowe znaczenie.

W porównaniu do poprzednich generacji kart graficznych, H100 oferuje:

- Bezkonkurencyjne przyspieszenie AI – Szybsze operacje macierzowe, większa przepustowość NVLink i wyższa efektywność pamięci.

- Skalowalność na przyszłość – Zoptymalizowane do szkolenia AI, HPC i obciążeń enterprise z obsługą PCIe 5.0.

Firmy obsługujące ogromne zbiory danych AI, symulacje na dużą skalę lub zaawansowane dostrajanie modeli najbardziej skorzystają na wdrożeniu serwerów AI gotowych na H100. Te serwery są zaprojektowane do obsługi obciążeń AI o dużej przepustowości, zapewniając szybsze czasy szkolenia, wnioskowanie w czasie rzeczywistym i płynną skalowalność przyszłych projektów AI.

Dzięki odnowionym serwerom AI firmy mogą zintegrować karty H100 przy niższych kosztach, unikając zbędnych wydatków na infrastrukturę, jednocześnie czerpiąc korzyści z najwyższej wydajności AI.

Poniżej przedstawiamy dwa wysokowydajne serwery AI, które w pełni obsługują karty NVIDIA H100, zapewniając firmom niezbędną moc obliczeniową bez nadmiernych kosztów.

Dell R750 vs. Lenovo SR650 V2 dla AI

Wybór odpowiedniego serwera dla AI i głębokiego uczenia jest kluczowy dla maksymalizacji wydajności i efektywności. Zarówno Dell PowerEdge R750, jak i Lenovo ThinkSystem SR650 V2 obsługują karty NVIDIA H100, ale są dostosowane do nieco innych potrzeb. R750 oferuje więcej gniazd PCIe dla lepszej rozbudowy, natomiast SR650 V2 koncentruje się na skalowalności i oszczędności kosztów. Poniżej znajduje się porównanie, które pomoże Ci zdecydować, który z nich najlepiej pasuje do Twojej infrastruktury AI.

| Funkcja | Dell PowerEdge R750 | Lenovo ThinkSystem SR650 V2 |

| Obsługa GPU | Do 2x NVIDIA H100 PCIe | Do 2x NVIDIA H100 PCIe |

| Opcje CPU | Intel Xeon Scalable (3. gen.) | Intel Xeon Scalable (3. gen.) |

| Pojemność pamięci | Obsługuje do 8TB DDR4/DDR5 | Obsługuje do 8TB DDR4/DDR5 |

| Możliwości przechowywania | Obsługuje do 28x dysków 2.5” (HDD/SSD) | Obsługuje do 20x dysków 2.5” (HDD/SSD) |

| Sieć i łączność | Podwójne porty 10GbE, gniazda PCIe Gen 5 dla przyszłej rozbudowy | Podwójne porty 10GbE, PCIe Gen 4, wysoka efektywność energetyczna |

| Rozbudowa i skalowalność | Więcej gniazd PCIe Gen 4/5 – Idealne dla konfiguracji z wieloma GPU i akceleratorów AI, takich jak NVIDIA NVLink Bridges. | Energooszczędna konstrukcja z chłodzeniem Lenovo Neptune™ – Skupia się na oszczędnościach kosztów przy zachowaniu wydajności AI. |

| Chłodzenie i zasilanie | Optymalizowane dla energochłonnych obciążeń AI – Wykorzystuje Dell Smart Cooling do obsługi wysokowydajnych GPU, takich jak H100. | Wydajne chłodzenie i zarządzanie energią – Wykorzystuje Lenovo XClarity Controller do optymalizacji zużycia energii w aplikacjach AI. |

| Format obudowy i gęstość | Serwer szafowy 2U – Większa gęstość dla AI w przedsiębiorstwach | Serwer szafowy 2U – Zaprojektowany dla skalowalności i modułowej rozbudowy AI |

| Zastosowanie | AI w przedsiębiorstwach i wysokowydajne obliczenia | Skalowalna infrastruktura AI i wdrożenia AI zoptymalizowane pod kątem kosztów |

Dell PowerEdge R750

Serwer klasy enterprise o wysokiej wydajności, zaprojektowany do przyspieszania AI, PowerEdge R750 obsługuje do dwóch kart NVIDIA H100 PCIe. Dzięki liniom PCIe Gen 4 i szybkim sieciom zapewnia moc niezbędną do szkolenia modeli AI, wnioskowania i aplikacji przetwarzających duże ilości danych.

- Optymalizacja dla AI i uczenia maszynowego – Obsługuje konfiguracje dwóch kart graficznych, przyspieszając obciążenia AI i wnioskowanie w czasie rzeczywistym.

- Wydajność klasy enterprise – Zapewnia wysoką przepustowość i efektywne zarządzanie energią, co czyni go mocnym wyborem dla firm opartych na AI i przedsiębiorstw.

Zwiększ wydajność AI dzięki PowerEdge R750

Lenovo ThinkSystem SR650 V2

Ten wszechstronny serwer rackowy został zaprojektowany dla firm wymagających skalowalności. Obsługując pełnowymiarowe karty GPU, w tym NVIDIA H100, jest zoptymalizowany pod kątem obciążeń AI wymagających szybkiego przetwarzania, głębokiego uczenia i analityki dużych zbiorów danych.

- Infrastruktura AI gotowa na przyszłość – Zaprojektowana do skalowalnych wdrożeń AI, zapewniając płynne rozszerzanie wraz ze wzrostem wymagań AI.

- Opłacalna wydajność – Odnowiony SR650 V2 pozwala firmom zintegrować infrastrukturę AI przy znacznie niższych kosztach, czyniąc wydajne AI bardziej dostępnym.

Zwiększ wydajność AI dzięki SR650 V2

Potrzebujesz pomocy w wyborze odpowiedniego serwera AI?

Wybór odpowiedniego serwera AI nie musi być trudny. Niezależnie od tego, czy potrzebujesz odnowionych kart NVIDIA A100 lub H100, czy profesjonalnych rekomendacji, jesteśmy tutaj, aby pomóc.

Jak możemy pomóc:

✔ Indywidualne doradztwo w zakresie serwerów AI – Znajdź najlepsze rozwiązanie dla szkolenia modeli AI lub głębokiego uczenia.

✔ Powiadomienia o stanie magazynowym i dostępności – Otrzymuj powiadomienia, gdy odnowione karty A100 lub H100 są ponownie dostępne, lub odkryj alternatywne rozwiązania.

Zaoszczędź do 70% na infrastrukturze AI – bez kompromisów w wydajności

Potrzebujesz opłacalnego szkolenia AI na kartach A100/V100 lub wysokiej wydajności kart H100? Skontaktuj się z nami teraz, aby uzyskać profesjonalne doradztwo, wycenę i informacje o dostępności.